Generative pre-trained transformer

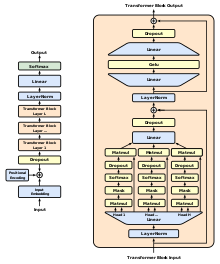

Generative pre-trained transformer (GPT) — варіант «штучного інтелекту»[1][2] — це сімейство мовних моделей, які зазвичай навчаються на великому корпусі текстових даних для створення тексту, схожого на текст людини. Вони побудовані з використанням декількох блоків трансформної архітектури. Їх можна точно налаштувати для виконання різноманітних завдань обробки природної мови, таких як генерація тексту, переклад мови та класифікація тексту. «Попереднє навчання» в його назві означає початковий процес навчання на великому текстовому корпусі, під час якого модель вчиться передбачати наступне слово в уривку, що забезпечує надійну основу для успішної роботи моделі в наступних завданнях з обмеженою кількістю даних, що стосуються конкретного завдання.

- ChatGPT (Chat Generative Pre-trained Transformer)[3] це чат-бот, запущений OpenAI у листопаді 2022 року. Він використовує GPT-3.5, і налаштований (підхід до перенесення навчання)[4] як на кероване навчання, так і навчання з підкріпленням.

- BioGPT це GPT, який фокусується на відповідях на біомедичні запитання.[5] Він розроблений Microsoft.[6]

- ProtGPT2 це GPT, який зосереджується на білковому дизайні.[7]

| Цей розділ містить неперекладені фрагменти англійською мовою. |

11 червня 2018 року OpenAI опублікував статтю під назвою «Покращення розуміння мови за допомогою генеративного попереднього навчання», в якому вони представили Generative Pre-trained Transformer (GPT).[8] На той момент, найефективніші нейронні моделі НЛП в основному використовували кероване навчання з великих обсягів даних, позначених вручну. Ця залежність від керованого навчання обмежувала їх використання в наборах даних, які не були добре анотованими, а також робила навчання надзвичайно великих моделей надто дорогим і трудомістким;[8][9] багато мов (наприклад, суахілі чи гаїтянська креольська) важко перекладати та інтерпретувати за допомогою таких моделей через брак доступного тексту для побудови корпусу.[9] На відміну від цього, «напівкерований» підхід GPT включав два етапи: некерований генеративний етап «попереднього навчання», на якому мета моделювання мови використовувалася для встановлення початкових параметрів, і керований етап дискримінаційного «тонкого налаштування», на якому ці параметри були адаптовані до цільового завдання.[8]

| Архітектура | Кількість параметрів | Тренувальні дані | Дата релізу | Вартість тренування | |

|---|---|---|---|---|---|

| GPT-1 | 12-level, 12-headed Transformer decoder (no encoder), followed by linear-softmax. | 0.12 млрд | BookCorpus:[10] 4.5 ГБ тексту, з 7000 невиданих книг різних жанрів. | 11.06.2018 | 1 місяць на 8 GPU (1.7e+19 FLOP) |

| GPT-2 | GPT-1, але з модифікованою нормалізацією | 1.5 млрд | WebText: 40 ГБ тексту, 8 млн документів, 45 млн вебсторінок з позитивними оцінками на Reddit | 14.02.2019(обмежена версія)/05.11.2019(повна версія) | Десятки петафлопс/s-day (1.5e+21 FLOP) |

| GPT-3 | GPT-2, but with modification to allow larger scaling. | 175 млрд | 570 ГБ plaintext, 0.4 trillion tokens. Mostly CommonCrawl, WebText, Англійська Вікіпедія, and two books corpora (Books1 and Books2). | 28.05.2020 | 3640 петафлопс/s-day (3.1e+23 FLOP) |

| GPT-3.5 | Засекречена | 175 млрд | Інформація засекречена | 15.03.2022 | Інформація засекречена |

| GPT-4 | Засекречена | Невідомо | Інформація засекречена | 14.03.2023 | Інформація засекречена (орієнтовно 2.1e+25 FLOP) |

- ↑ Henry Kissinger, Eric Schmidt and Daniel Huttenlocher. A Robot Wrote This Book Review

- ↑ https://konkurent.ua/publication/112626/shtuchniy-intelekt-scho-bude-yakscho-ludini-ne-vdastsya-prokontroluvati-tehnologiu/ Штучний інтелект: що буде, якщо людині не вдасться проконтролювати технологію

- ↑ Roose, Kevin (5 грудня 2022). The Brilliance and Weirdness of ChatGPT. The New York Times (амер.). Архів оригіналу за 18 січня 2023. Процитовано 26 грудня 2022.

Like those tools, ChatGPT — which stands for "generative pre-trained transformer" — landed with a splash.

- ↑ Quinn, Joanne (2020). Dive into deep learning: tools for engagement. Thousand Oaks, California. с. 551. ISBN 9781544361376. Архів оригіналу за 10 січня 2023. Процитовано 10 січня 2023.

- ↑ Luo R, Sun L, Xia Y, Qin T, Zhang S, Poon H та ін. (2022). BioGPT: generative pre-trained transformer for biomedical text generation and mining. Brief Bioinform. 23 (6). doi:10.1093/bib/bbac409. PMID 36156661.

- ↑ Matthias Bastian (29 січня 2023). BioGPT is a Microsoft language model trained for biomedical tasks. The Decoder.

- ↑ Ferruz, N., Schmidt, S. & Höcker, B. та ін. (2022). ProtGPT2 is a deep unsupervised language model for protein design. Nature Communications volume. 13. doi:10.1038/s41467-022-32007-7.

- ↑ а б в Radford, Alec; Narasimhan, Karthik; Salimans, Tim; Sutskever, Ilya (11 червня 2018). Improving Language Understanding by Generative Pre-Training (PDF). OpenAI. с. 12. Архів (PDF) оригіналу за 26 січня 2021. Процитовано 23 січня 2021.

- ↑ а б Tsvetkov, Yulia (22 червня 2017). Opportunities and Challenges in Working with Low-Resource Languages (PDF). Carnegie Mellon University. Архів (PDF) оригіналу за 31 березня 2020. Процитовано 23 січня 2021.

- ↑ Zhu, Yukun; Kiros, Ryan; Zemel, Rich; Salakhutdinov, Ruslan; Urtasun, Raquel; Torralba, Antonio; Fidler, Sanja (2015). Aligning Books and Movies: Towards Story-Like Visual Explanations by Watching Movies and Reading Books: 19—27.