Análise numérica

A análise numérica ou cálculo numérico é a rama das matemáticas que concirne coa derivación, descrición e análise de ferramentas e métodos para obter solucións numéricas de problemas matemáticos[2][3]. A análise numérica está interesada en métodos matemáticos construtivos, isto é, aqueles métodos que mostran como construír solucións de problemas matemáticos. Por exemplo, unha proba construtiva da existencia dunha solución dun problema non só mostra que a solución existe, senón que tamén describe como debe ser determinada esa solución. Unha demostración da existencia dunha solución por redución ao absurdo non é construtiva[2].

Durante moito tempo a palabra algoritmo usouse como sinónimo de "método" no contexto de construír a solución dun problema matemático. Recentemente deseñouse unha definición matemática máis axeitada de algoritmo, en gran parte debida ao traballo de Alan Mathison Turing (1912-54), que deu unha definición baseada nun concepto abstracto dun computador[2]. Para os propósitos deste artigo, consideraremos un algoritmo como a descrición completa e sen ambigüidades dun método de construción da solución dun problema matemático[2]; deste xeito, podemos definir a análise numérica como o estudo de algoritmos que empregan a aproximación numérica (no canto da computación simbólica) para os problemas da análise matemática (a diferenza das matemáticas discretas)[4].

Aínda que hoxe en día se deseñan moitos algoritmos numéricos para seren usados nos ordenadores dixitais, a análise numérica non debe confundirse coa programación computacional nin co procesamento de datos. A programación computacional concirne primariamente co problema de codificar algoritmos (non necesariamente numéricos) dunha forma axeitada para un ordenador; mentres que o procesamento de datos ten que ver cos problemas relativos a organizar un ordenador para que poidan ser manipulados os datos, os cales non teñen por que seren numéricos[2].

Campos relacionados coa análise numérica son a computación científica, que estuda a aplicación de técnicas numéricas e arquitectura de ordenadores a problemas concretos xurdidos nas ciencias e enxeñarías; a teoría da complexidade, que analiza o número de "operacións" e a cantidade de memoria do ordenador necesarias para resolver un problema; e a computación paralela, que concirne coa organización de procedementos computacionais de maneira que sexa posible executar varias partes dos procedementos simultaneamente en diferentes procesadores[3].

Os problemas que resolve a análise numérica aparecen en moitas disciplinas: ciencias naturais, ciencias sociais, enxeñaría, medicina, e nos negocios. Desde a metade do século XX, o crecemento en potencia e dispoñibilidade dos ordenadores dixitais levou a un incremento no uso de modelos matemáticos realistas en ciencia e enxeñaría; e é necesaria unha análise matemática cada vez máis sofisticada para resolveren aqueles modelos máis detallados do mundo[5].

A análise numérica continúa esta longa tradición de cálculos matemáticos prácticos. Ao xeito da aproximación babilónica de , a análise numérica moderna non busca respostas exactas, xa que asume que estas son imposibles de obter na práctica. No canto disto, a análise numérica preocúpase de obter solucións aproximadas mantendo unhas marxes razoables de erro.

Un concepto paralelo á análise numérica é o da representación, tanto dos números como doutros conceptos matemáticos como os vectores, polinomios etc. Por exemplo, para a representación en ordenadores de números reais, emprégase o concepto de coma flotante que dista moito do empregado pola matemática convencional. En xeral, estes métodos aplícanse cando se precisa un valor numérico como solución a un problema matemático, e os procedementos "exactos" ou "analíticos" son incapaces de dar unha resposta. Debido a isto, son procedementos de uso frecuente por físicos e enxeñeiros, e o seu desenvolvemento viuse favorecido pola necesidade destes de obter solucións, aínda que a precisión non sexa total. A física experimental, por exemplo, non ofrece nunca valores exactos senón intervalos que abranguen a maioría dos resultados experimentais obtidos, xa que non é habitual que dúas medidas do mesmo fenómeno dean valores exactamente iguais.

Historia

[editar | editar a fonte]

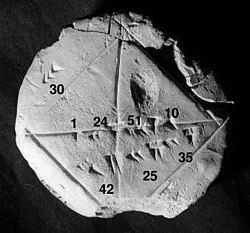

Os algoritmos numéricos son case tan antigos coma a civilización humana. Os babilonios, vinte séculos antes de Cristo, xa posuían táboas de cadrados de todos os enteiros entre 1 e 60. Un dos primeiros escritos matemáticos, tamén de autoría babilonia, é a taboíña YBC 7289, que dá unha aproximación numérica sesaxesimal de , considerándoa coma a lonxitude da diagonal do cadrado de lado a unidade[1]. Esta destreza segue a ter hoxe en día a súa aplicación práctica, por exemplo, en carpintería e construción[6].

Os exípcios, que xa usaban fraccións, inventaron o chamado método da regula falsi para aproximar solucións dunha ecuación, descrito no papiro de Rhind (c. 1650 a.C.)[7].

Na Grecia antiga foron moitos os matemáticos que contribuíron ao pulo desta disciplina. Así, Arquímedes (278-212 a.C.) demostrou que:

e presentou o chamado método exhaustivo para calcular lonxitudes, áreas e volumes de figuras xeométricas, moi próximo ao que hoxe se fai en análise numérica. Así mesmo foi tamén un precursor do desenvolvemento do cálculo integral de Isaac Newton (1643-1729) e Gottfried Wilhelm Leibniz (1646-1716)[7].

Herón de Alexandría ideou no século I un método para calcular un valor aproximado da raíz cadrada dun número a, partindo dunha aproximación inicial x0 e mediante a iteración[7][8]:

No ano 250, Diofanto consegue un método para a determinación das solucións dunha ecuación cuadrática[7].

As maiores contribucións durante a Idade Media para o desenvolvemento da matemática algorítmica viñeran principalmente da India e a China. O máis salientable é, sen dúbida, a introdución da chamada numeración hindú-árabe[7].

Coa aparición do cálculo e o descubrimento dos logaritmos no século XVII, os novos modelos matemáticos propostos non podían resolverse de forma explícita, facéndose necesario o desenvolvemento de métodos numéricos para obter solucións aproximadas. Por exemplo, Newton desenvolveu varios métodos para a resolución de moitos problemas, métodos que hoxe levan o seu nome. Esta técnica continuou desenvolvéndose nos séculos XVIII e XIX, podéndose destacar na construción de métodos numéricos a Leonhard Euler (1707-1783), Joseph Louis Lagrange (1736-1813) e Carl Friedrich Gauss (1777-1875)[7].

A aparición dos ordenadores contribuíu decisivamente ao desenvolvemento da análise numérica. A pesar de que tanto Pascal coma Leibniz xa construíran no século XVII as primeiras máquinas de calcular e de que Charles Babbage construíu o considerado primeiro ordenador que nunca funcionou, non foi ata a década dos 40 do século XX cando aparece o primeiro ordenador coa construción do ENIAC, ao que seguiron moitos máis que evolucionaron ata chegar aos modernos ordenadores electrónicos[7].

Antes da chegada das computadoras modernas, os métodos numéricos adoitaban depender de interpolacións manuais en longas táboas impresas. Desde mediados do século XX as computadoras calculan as funcións requiridas. Porén, os algoritmos de interpolación pódense usar coma parte do software para resolver ecuacións diferenciais[9].

A análise numérica atopa aplicacións en tódolos campos da enxeñaría e as ciencias naturais, mais no século XXI, as ciencias sociais e incluso as artes adoptaron elementos do cálculo científico. As ecuacións diferenciais ordinarias aparecen nos movementos dos corpos celestes (planetas, estrelas e galaxias); a optimización ten lugar na xestión de catálogos; a álxebra lineal numérica é importante para a análise de datos[10][11][12]; as ecuacións diferenciais estocásticas e as cadeas de Markov son esenciais na simulación de células vivas na medicina e a bioloxía.

Problemas que trata e tipos de erros

[editar | editar a fonte]Os problemas desta disciplina pódense dividir en dous grupos fundamentais[13]:

- Problemas en dimensión finita: aqueles de natureza numérica nos que interveñen números en cantidade finita, como o cálculo de solucións de ecuacións alxébricas, cálculo de determinantes, resolución de sistemas de ecuacións, inversión de matrices, cálculo de autovalores e autovectores etc.

En todos estes problemas, a análise numérica debe proporcionar algoritmos que permitan o cálculo exacto ou aproximado da solución.

- Problemas en dimensión infinita: problemas nos que interveñen elementos con infinitos graos de liberdade (por exemplo, funcións), como a interpolación e aproximación, a integración e a derivación numéricas, a resolucións de ecuacións diferenciais, a interpolación etc.

A análise numérica debe ocuparse da aproximación dun problema deste segundo tipo por outros do primeiro, de maneira que serán estes últimos os que se resolvan coa axuda dos ordenadores. O proceso de aproximación dun problema en dimensión infinita polo paso a dimensión finita coñécese como discretización[13] e realízase principalmente coa axuda da teoría da interpolación e aproximación de funcións. En xeral, a discretización será boa cando a solución do problema aproximado converxa á do problema inicial, cando a dimensión tenda a infinito.

Neste problema de convexencia é importante a estimación do erro cometido ao substituír a solución exacta pola aproximada, isto é, o chamado erro de discretización. Unha vez reducido o problema en dimensión infinita a un en dimensión finita, hai que describir e analizar os algoritmos numéricos que se van utilizar na súa resolución. Con frecuencia preséntanse problemas que non poden resolverse mediante métodos directos (aqueles que nun número finito de operacións chégase á solución exacta), sendo necesario o uso de métodos iterativos: constrúese unha sucesión infinita de iterantes que no límite converxe á solución exacta, aínda que na práctica só se poderán calcular un número finito de iterantes. O erro que se comete ao deter o proceso infinito nun paso determinado, chamado erro de truncamento, ou erro de converxencia[13], debe considerarse cuidadosamente.

De especial importancia no cálculo a gran escale é un terceiro tipo de erro, o erro de arredondamento[13], debido á imposibilidade de representar exactamente nun ordenador todas as cifras dun número, tanto real coma complexo. Se a isto engadimos que a aritmética utilizada polo ordenador é diferente á que manexamos habitualmente, comprenderase a importancia deste erro cando se realizan un número elevado de cálculos.

Un algoritmo numericamente inestable, é dicir, aquel que é moi sensible aos erros de arredondamento, debe ser desbotado, xa que os resultados que proporcione poden diferir totalmente da solución real do problema. Para estudar a propagación dos erros precísase coñecer o condicionamento[13] do problema, é dicir, a sesibilidade dos resultados do problema fronte a pequenos cambios nos datos de partida. A resolución dun problema mal condicionado leva a un funcionamento incerto dos algoritmos. Nestes casos haberá que mellorar o condicionamento, dalgunha maneira equilibrar o problema. Todas estas razóns fan necesaria a busca de algoritmos co menor número posible de operacións, ou algoritmos de baixo custo.

Tendo en conta estas consideracións, pódense distinguir tres tipos de problemas nos que intervén a análise numérica[13]:

- Problemas de gran complexidade matemática que requiren unha solución aproximada xa que non teñen unha solución analítica coñecida. A análise numérica ocúpase de propor e analizar métodos que dean aproximacións da solución requirida. Un bo exemplo é o problema da predición do tempo atmosférico.

- Problemas que poden ser resoltos analiticamente pero cuxa solución non poida ser explotada na práctica. Neste caso a análise numérica ocúpase de proporcionar algún método para a aproximación da solución que sexa sinxelo e que permita substituír a solución exacta. Por exemplo a función de Bessel en electromagnetismo.

- Problemas que posúen solución exacta matemática calculable mediante un método exacto, pero que na práctica é inservible ao consumir moito tempo de cálculo ou ocupar moita memoria para almacenamento de datos. A análise numérica propón métodos numéricos alternativos. Un exemplo é o uso da regra de Cramer para a resolución dun sistema de ecuacións lineais cun número importante de ecuacións; así, un sistema de Cramer de 10 ecuacións necesita arredor de 40 millóns de operacións para a súa resolución.

Áreas de estudo

[editar | editar a fonte]A análise numérica divídese en diferentes disciplinas segundo o problema que hai que resolver. Algunhas das principais son:

Cálculo dos valores dunha función

[editar | editar a fonte]Un dos problemas máis sinxelos é a avaliación dunha función para un valor dado. O enfoque máis sinxelo, de substituír o número na fórmula da función, non é, ás veces, moi eficiente polo alto número de operacións a realizar. Neste caso, para as funcións polinómicas, conséguese unha boa aproximación usando o algoritmo de Horner[14], xa que reduce o número necesario de multiplicacións e sumas a realizar. Xeralmente, é importante estimar e controlar os erros de arredondamento derivados do uso da coma flotante aritmética[14].

Interpolación, extrapolación, e regresión

[editar | editar a fonte]A interpolación consiste en estimar o valor dunha función descoñecida en puntos comprendidos entre outros puntos nos que se coñece o valor da función.

A extrapolación é moi similar á interpolación, só que agora o valor da función quérese estimar en puntos fóra do intervalo no que están os puntos nos que se coñece o valor[15].

A regresión é tamén similar, mais tendo en conta que os datos son imprecisos. Dados algúns puntos e unha medida, cun certo erro, do valor dunha función neses puntos, pódese encontrar unha aproximación á función descoñecida, máis ou menos precisa dependendo do tipo de función e do método usado. Uns destes métodos son os métodos numéricos dos mínimos cadrados.

Resolución de ecuacións e sistemas de ecuacións

[editar | editar a fonte]Outro problema fundamental é calcular a solución dunha ecuación dada. Distínguense dous casos dependendo de se a ecuación é linear ou non. Por exemplo, a ecuación é linear, mentres que a ecuación de segundo grao non o é[14].

Fíxose un grande esforzo en desenvolver métodos para resolver sistemas de ecuacións lineares. Os métodos directos estándar, isto é, aqueles que usan algunha descomposición matricial, son a eliminación gaussiana, a descomposición LU, a factorización de Cholesky para matrices simétricas (ou hermitianas no campo complexo) e definidas positivas, e a descomposición OR para matrices non cadradas[14]. Os métodos iterativos coma o de Jacobi, o de Gauss-Seidel, o da sobrerrelaxación sucesiva (SOR), e o do gradiente conxugado[16], son os preferidos normalmente para sistemas grandes. Os métodos iterativos xerais poden ser desenvolvidos usando a descomposición de matrices como suma ou diferenza doutras[14].

Os algoritmos de procura dun cero úsanse para resolveren ecuacións non lineares[14] (chámanse así pois unha raíz ou cero dunha función é un valor para o que a función vale cero). Algúns dos métodos máis coñecidos son os de bisección, da secante e da regula falsi. Se a función é ademais derivable e a derivada é coñecida, emprégase moito o método de Newton[14][17][18], que é un método de iteración de punto fixo. A linearización é outro método empregado para resolveren ecuacións non lineares[14].

Descomposición en valores propios e en valores singulares

[editar | editar a fonte]Algúns problemas importantes poden expresarse en termos de descomposición dunha matriz en valores propios ou en valores singulares. Por exemplo, o algoritmo da compresión espectral da imaxe baséase na descomposición en valores singulares, e a correspondente ferramenta en estatística chámase análise de compoñentes principais[14].

Optimización

[editar | editar a fonte]O problema de maximizar (ou minimizar)unha función dada nun punto, coñécese como problema de optimización. Con frecuencia, o valor buscado está suxeito a unha serie de restricións[14].

O campo da optimización divídese en varios subcampos, dependendo da forma da función obxectivo e das restricións. Por exemplo, na programación linear tanto a función obxectivo como as restricións son lineares. Un método célebre de programación linear é o método do simplex[14].

O método dos multiplicadores de Lagrange pode usarse para reducir un problema de optimización con restricións, a un que non as teña[14].

Integración numérica

[editar | editar a fonte]A integración numérica, ás veces chamada cuadratura numérica, úsase para estimar o valor dunha integral definida[14][19]. Os métodos máis populares empregan algunha das fórmulas de Newton–Cotes, como a regra de Simpson, ou o método da cuadratura gaussiana[20]. Estes métodos baséanse nunha estratexia de "divide e vencerás", consistente en dividir o intervalo de integración en subintervalos máis pequenos para facilitar o cálculo da integral e sumando despois todas estas integrais para calcular a inicial[14].

En dimensións superiores, onde os métodos anteriores fanse prohibitivos en termos de esforzo computacional, úsase a integración de Montecarlo, baseada nos métodos de Montecarlo e quasi-Montecarlo[21]; ou, para grandes dimensións máis modestas o método da cuadrícula dispersa[14].

Ecuacións diferenciais numéricas

[editar | editar a fonte]A análise numérica tamén pode calcular solucións aproximadas de ecuacións diferenciais, tanto ordinarias como en derivadas parciais[22].

Os métodos empregados adoitan basearse en discretizar primeiramente a ecuación correspondente, traéndoa a un subespazo de dimensión finita[23]. Isto pode facerse cun método dos elementos finitos[24][25][26], un método de diferenzas finitas[27] ou, particularmente en enxeñaría, un método dos volumes finitos[28]. A xustificación teórica destes métodos adoita implicar teoremas da análise funcional, co cal se reduce o problema á solución dunha ecuación alxébrica[14].

Notas

[editar | editar a fonte]- ↑ 1,0 1,1 Melville, Duncan J. (18 de setembro de 2006). St. Lawrence University, ed. "YBC 7289" (en inglés). Arquivado dende o orixinal o 13 de agosto de 2012. Consultado o 11 de xaneiro de 2011.

Fotografía, ilustración e descrición da tableta "raíz(2)" da Colección Babilónica de Yale (YBC).

- ↑ 2,0 2,1 2,2 2,3 2,4 Phillips & Taylor 1996, pp. 1-3

- ↑ 3,0 3,1 Gautschi 2012, p. xix

- ↑ UK Research and Innovation (ed.). "Numerical Analysis" (en inglés).

- ↑ Atkinson, Kendall E. "Numerical Analysis". Encyclopædia Britannica (en inglés).

- ↑ New Zealand Qualifications Authority, ed. (25 de xaneiro de 2008). "Carpentry Theory: Demonstrate knowledge of setting out a building" (PDF) (en inglés).

- ↑ 7,0 7,1 7,2 7,3 7,4 7,5 7,6 Martíns 2002, pp. 4-5

- ↑ J. LLopis. "Herón de Alejandría". matesfacil.com (en castelán). Consultado o 10 de agosto de 2020.

- ↑ Brezinsky & Wuytack 2012

- ↑ Demmel, James W. (1997). Applied numerical linear algebra. Other Titles in Applied Mathematics (en inglés) 56. Society for Industrial and Applied Mathematics (SIAM). ISBN 0898713897.

- ↑ Ciarlet, Philippe G. (1988). Introduction à l'analyse numérique matricielle et à l'optimisation (en francés). Masson. ISBN 2-225-68893-1.

- ↑ Lloyd N. Trefethen; David Bau III (1997). Numerical Linear Algebra. Other Titles in Applied Mathematics (en inglés) 50. Philadelphia: Society for Industrial and Applied Mathematics (SIAM). ISBN 9780898719574.

- ↑ 13,0 13,1 13,2 13,3 13,4 13,5 Álvarez Vázquez, Lino J.; Martínez Varela, Áurea M. (2004). Lecciones de métodos numéricos (en castelán). ETES Telecomunicación, Universidade de Vigo. pp. 6–10. ISBN 84-9336-623-4.

- ↑ 14,00 14,01 14,02 14,03 14,04 14,05 14,06 14,07 14,08 14,09 14,10 14,11 14,12 14,13 14,14 14,15 Mukerji, Khan & Singh 2018, pp. 314-318

- ↑ Brezinski, Claude; Redivo Zaglia, Michela (2013). Extrapolation methods: theory and practice (en inglés). Elsevier. ISBN 9780080506227.

- ↑ Hestenes, Magnus R.; Stiefel, Eduard (decembro 1952). "Methods of Conjugate Gradients for Solving Linear Systems" (PDF). Journal of Research of the National Bureau of Standards (en inglés) 49 (6): 409–436.

- ↑ Ezquerro Fernández, José Antonio; Hernández Verón, Miguel Ángel (2017). Newton’s method: An updated approach of Kantorovich’s theory (en inglés). Birkhäuser. ISBN 9783319559766.

- ↑ Deuflhard, Peter (2011). Newton Methods for Nonlinear Problems. Affine Invariance and Adaptive Algorithms. Series Computational Mathematics (en inglés). Springer. ISBN 9783642238994.

- ↑ Davis, Philip J.; Rabinowitz, Philip (2014). Werner Rheinbolt, ed. Methods of numerical integration (en inglés) (2ª ed.). Academic Press. p. 1. ISBN 9781483264288.

- ↑ Weisstein, Eric W. "Gaussian quadrature". MathWorld-A Wolfram Web Resource (en inglés). Consultado o 19 de agosto de 2020.

- ↑ Geweke, J. (1996). "Monte Carlo simulation and numerical integration". En H. Amman; D. Kendrick; J. Rust. Handbook of Computational Economics (en inglés). Amsterdam: North-Holland. pp. 731–800.

- ↑ Iserles, Arieh (2009). A first course in the numerical analysis of differential equations. Cambridge Texts in Applied Mathematics (en inglés) 44 (3ª ed.). Cambridge University Press. ISBN 9780521734905.

- ↑ Ames, William F. (2014). Numerical methods for partial differential equations. Computer Science and Scientific Computing (en inglés). Academic Press. ISBN 9780080571300.

- ↑ Johnson, Claes (2012). Numerical solution of partial differential equations by the finite element method. Dover Books on Mathematics Series (en inglés). Courier Corporation. ISBN 9780486131597.

- ↑ Brenner, Susanne C.; Scott, L. Ridgway (2013). The mathematical theory of finite element methods. Texts in Applied Mathematics (en inglés) 15. Springer Science & Business Media. ISBN 9781475736588.

- ↑ Fix, George J.; Strang, William Gilbert (1973). An analysis of the finite element method. Prentice-Hall series in automatic computation (en inglés). Prentice-Hall. ISBN 9780964108882.

- ↑ Strikwerda, John C. (2007). Finite difference schemes and partial differential equations. Other Titles in Applied Mathematics (en inglés) 88 (2ª ed.). SIAM. ISBN 9780898716399.

- ↑ Leveque, Randall J. (2002). Finite Volume Methods for Hyperbolic Problems. Cambridge Texts in Applied Mathematics (en inglés) 31. Cambridge University Press. ISBN 9780521009249.

Véxase tamén

[editar | editar a fonte]| Wikimedia Commons ten máis contidos multimedia na categoría: Análise numérica |

Bibliografía

[editar | editar a fonte]- Brezinski, C.; Wuytack, L. (2012). Numerical analysis: Historical developments in the 20th century (en inglés). Elsevier. ISBN 0444598588.

- Gautschi, Walter (2012). Numerical Analysis (en inglés). Springer Science & Business Media. ISBN 0817682597.

- Martíns Araújo, Adérito Luís (2002). Análise Numérica. Engenharias Mecânica e de Materiais (en portugués). Faculdade de Cièncias e Tecnologia da Universadade de Coimbra.

- Mukerji, Saurabh Kumar; Khan, Ahmad Shahid; Singh, Yatendra Pal (2018). Electromagnetics for Electrical Machines (en inglés). CRC Press. ISBN 9781498709156.

- Phillips, G.M.; Taylor, P.J. (1996). Theory and Applications of Numerical Analysis (en inglés) (2ª ed.). Elsevier Academic Press. ISBN 0-12-553560-0. doi:10.1016/B978-012553560-1/50002-1.

Ligazóns externas

[editar | editar a fonte]- Grupo de métodos numéricos en enxeñería (ETS Enxeñeiros de Camiños da Universidade da Coruña)

- Notas sobre métodos numéricos básicos para ingeniería Arquivado 26 de agosto de 2009 en Wayback Machine.

- Numerical analysis DMOZ category

- Numerical Analysis Project by John H. Mathews

- Alternatives to Numerical Recipes

- The definition of numerical analysis